뒷 부분의 output은 벡터일수도, 스칼라 값일 수도 있다.

대체로 이런 형태를 갖는 것일뿐, 목적에 따라 다양한 형태를 갖는다.

앞서 neural network에서 학습의 목표는 알맞은 weight를 찾는 것이라 했다.

이번에는 어떻게 알맞은 weight를 계산하는지 다루려한다.

최적의 weight는

1) 계산

2) 실제 값과의 차이만큼 조정

하는 것을 반복함으로써 계산한다.

어떻게 계산하는지 - feedforward

실제 값과의 차이만큼 조정 - loss function, backpropagation

이렇게 나눌 수 있다.

Feedforward

3-2. neural network의 구조, activation function에서

neuron 단위에서 연산을 어떻게 이루어지는지 살펴보았다.

이 연산 과정은 input에서 output방향으로, 모든 neuron과 layer에서 일어난다. 이것을 feedfoward라고 한다.

input으로부터 output 방향으로 forward하게 이루어지기 때문에 이런 이름이 붙었다.

input이 vector이고 vector연산은 행렬을 통해 쉽게 계산할 수 있다.

따라서 feedforward연산은 다음과 같이 표현할 수 있다.

출처: https://www.jeremyjordan.me/intro-to-neural-networks/

Loss Function / cost function : 손실 함수

loss와 cost는 없어지는 것, 잃는 것, 손실이라는 비슷한 의미를 갖는다.

여기서 잃는다는 것은 정답과의 차이를 의미한다.

supervised learning은 정답을 아는 상태에서 학습하는 것이라 했다.

x를 넣어서 계산하면 y값을 얻는다.

이 y 값과 실제 정답인 t의 차이의 합을 loss/cost 라고 한다.

흔히 쓰이는 loss function에는 평균오차제곱(MSE : Mean Squared Errror), cross entropy(교차 엔트로피)가 있다.

평균 오차 제곱은 아래와 같다.

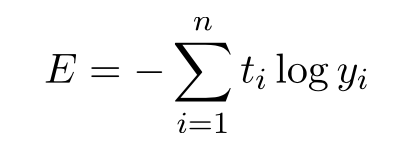

cross entropy는 아래와 같다.

unsupervised learning에서는 조금 다른 개념을 사용한다.

unsupervised learning은 정답이 없다. 따라서 알고리즘에 따라 loss function을 다르게 정의한다.

'Machine Learning > 이론 정리' 카테고리의 다른 글

| 4. CNN: 합성곱 신경망(그림으로 이해하는) (0) | 2020.02.15 |

|---|---|

| 3-4. Neural Network 연산 - Backpropagation(역전파) (0) | 2020.02.14 |

| 3-2. Neural Network(인공 신경망) 의 구조, activation function(활성함수) (0) | 2020.02.12 |

| 3-1. neural network(인공 신경망)의 기본 개념 (0) | 2020.02.11 |

| 2. 인공지능(artificial intelligence) vs. 머신러닝(machine learning) vs vs. 인공 신경망(neural network) 비교 (0) | 2020.02.11 |